តើឯកសារ Robots.txt ជាអ្វី? អ្វីគ្រប់យ៉ាងដែលអ្នកត្រូវការដើម្បីសរសេរ បញ្ជូន និងប្រមូលឯកសារមនុស្សយន្តឡើងវិញសម្រាប់ SEO

យើងបានសរសេរអត្ថបទដ៏ទូលំទូលាយមួយនៅលើ របៀបដែលម៉ាស៊ីនស្វែងរកស្វែងរក រុករក និងធ្វើលិបិក្រមគេហទំព័ររបស់អ្នក។. ជំហានជាមូលដ្ឋាននៅក្នុងដំណើរការនោះគឺ robots.txt ឯកសារ ដែលជាច្រកផ្លូវសម្រាប់ម៉ាស៊ីនស្វែងរកដើម្បីរុករកគេហទំព័ររបស់អ្នក។ ការយល់ដឹងពីរបៀបបង្កើតឯកសារ robots.txt ឱ្យបានត្រឹមត្រូវគឺចាំបាច់ក្នុងការបង្កើនប្រសិទ្ធភាពម៉ាស៊ីនស្វែងរក (SEO

).

ឧបករណ៍ដ៏សាមញ្ញ ប៉ុន្តែមានអនុភាពនេះជួយអ្នកគ្រប់គ្រងគេហទំព័រគ្រប់គ្រងពីរបៀបដែលម៉ាស៊ីនស្វែងរកធ្វើអន្តរកម្មជាមួយគេហទំព័ររបស់ពួកគេ។ ការយល់ដឹង និងការប្រើប្រាស់ឯកសារ robots.txt ប្រកបដោយប្រសិទ្ធភាពគឺចាំបាច់សម្រាប់ធានាឱ្យមានការបង្កើតលិបិក្រមប្រកបដោយប្រសិទ្ធភាពនៃគេហទំព័រ និងលទ្ធភាពមើលឃើញដ៏ល្អប្រសើរនៅក្នុងលទ្ធផលម៉ាស៊ីនស្វែងរក។

តើឯកសារ Robots.txt ជាអ្វី?

ឯកសារ robots.txt គឺជាឯកសារអត្ថបទដែលមានទីតាំងនៅក្នុងថតឫសនៃគេហទំព័រ។ គោលបំណងចម្បងរបស់វាគឺដើម្បីណែនាំអ្នករុករកម៉ាស៊ីនស្វែងរកអំពីផ្នែកណាមួយនៃគេហទំព័រគួរ ឬមិនគួរត្រូវបានរុករក និងធ្វើលិបិក្រម។ ឯកសារប្រើពិធីការលើកលែងមនុស្សយន្ត (REP) គេហទំព័រស្ដង់ដារប្រើដើម្បីទំនាក់ទំនងជាមួយអ្នករុករកគេហទំព័រ និងមនុស្សយន្តបណ្ដាញផ្សេងទៀត។

REP មិនមែនជាស្តង់ដារអ៊ីនធឺណិតផ្លូវការទេ ប៉ុន្តែត្រូវបានទទួលយក និងគាំទ្រយ៉ាងទូលំទូលាយដោយម៉ាស៊ីនស្វែងរកធំៗ។ ជិតបំផុតទៅនឹងស្តង់ដារដែលទទួលយកបានគឺឯកសារពីម៉ាស៊ីនស្វែងរកធំៗដូចជា Google, Bing និង Yandex។ សម្រាប់ព័ត៌មានបន្ថែម សូមចូលទៅកាន់ លក្ខណៈបច្ចេកទេសរបស់ Google's Robots.txt ត្រូវបានផ្ដល់អនុសាសន៍។

ហេតុអ្វីបានជា Robots.txt មានសារៈសំខាន់ចំពោះ SEO?

- ការគ្រប់គ្រងវារ៖ Robots.txt អនុញ្ញាតឱ្យម្ចាស់គេហទំព័ររារាំងម៉ាស៊ីនស្វែងរកពីការចូលទៅកាន់ផ្នែកជាក់លាក់នៃគេហទំព័ររបស់ពួកគេ។ វាមានប្រយោជន៍ជាពិសេសសម្រាប់ការមិនរាប់បញ្ចូលខ្លឹមសារស្ទួន តំបន់ឯកជន ឬផ្នែកដែលមានព័ត៌មានរសើប។

- ថវិការដែលធ្វើអោយប្រសើរឡើង៖ ម៉ាស៊ីនស្វែងរកបែងចែកថវិការសម្រាប់គេហទំព័រនីមួយៗ ចំនួនទំព័រដែលម៉ាស៊ីនស្វែងរកនឹងរុករកនៅលើគេហទំព័រមួយ។ ដោយការមិនអនុញ្ញាតផ្នែកដែលមិនពាក់ព័ន្ធ ឬមិនសូវសំខាន់នោះ robots.txt ជួយបង្កើនប្រសិទ្ធភាពថវិការុករកនេះ ដោយធានាថាទំព័រសំខាន់ៗជាច្រើនទៀតត្រូវបានរុករក និងធ្វើលិបិក្រម។

- ពេលវេលាផ្ទុកគេហទំព័រប្រសើរឡើង៖ តាមរយៈការការពារ bots ពីការចូលប្រើធនធានដែលមិនសំខាន់ robots.txt អាចកាត់បន្ថយការផ្ទុកម៉ាស៊ីនមេ ដែលអាចធ្វើអោយប្រសើរឡើងនូវពេលវេលាផ្ទុកគេហទំព័រ ដែលជាកត្តាសំខាន់នៅក្នុង SEO ។

- ការទប់ស្កាត់ការធ្វើលិបិក្រមនៃទំព័រដែលមិនមែនជាសាធារណៈ៖ វាជួយរក្សាតំបន់មិនមែនជាសាធារណៈ (ដូចជាកន្លែងរៀបចំឆាក ឬតំបន់អភិវឌ្ឍន៍) ពីការធ្វើលិបិក្រម និងបង្ហាញក្នុងលទ្ធផលស្វែងរក។

ពាក្យបញ្ជាសំខាន់ៗ Robots.txt និងការប្រើប្រាស់របស់ពួកគេ។

- អនុញ្ញាត៖ ការណែនាំនេះត្រូវបានប្រើដើម្បីបញ្ជាក់ទំព័រ ឬផ្នែកនៃគេហទំព័រដែលគួរត្រូវបានចូលប្រើដោយ crawlers ។ ឧទាហរណ៍ ប្រសិនបើគេហទំព័រមួយមានផ្នែកពាក់ព័ន្ធជាពិសេសសម្រាប់ SEO នោះពាក្យបញ្ជា 'អនុញ្ញាត' អាចធានាថាវាត្រូវបានរុករក។

Allow: /public/- មិនអនុញ្ញាត៖ ផ្ទុយពី 'អនុញ្ញាត' ពាក្យបញ្ជានេះណែនាំ bots ម៉ាស៊ីនស្វែងរកមិនឱ្យរុករកផ្នែកខ្លះនៃគេហទំព័រ។ វាមានប្រយោជន៍សម្រាប់ទំព័រដែលមិនមានតម្លៃ SEO ដូចជាទំព័រចូល ឬឯកសារស្គ្រីប។

Disallow: /private/- អក្សរជំនួស៖ អក្សរជំនួសត្រូវបានប្រើសម្រាប់ការផ្គូផ្គងលំនាំ។ សញ្ញាផ្កាយ (*) តំណាងឱ្យលំដាប់នៃតួអក្សរណាមួយ ហើយសញ្ញាដុល្លារ ($) តំណាងឱ្យចុងបញ្ចប់នៃ URL មួយ។ ទាំងនេះមានប្រយោជន៍ក្នុងការបញ្ជាក់ URL ដ៏ធំទូលាយមួយ។

Disallow: /*.pdf$- ផែនទីគេហទំព័រ៖ រួមទាំងទីតាំងផែនទីគេហទំព័រនៅក្នុង robots.txt ជួយឱ្យម៉ាស៊ីនស្វែងរកស្វែងរក និងរុករកទំព័រសំខាន់ៗទាំងអស់នៅលើគេហទំព័រមួយ។ នេះមានសារៈសំខាន់សម្រាប់ SEO ព្រោះវាជួយក្នុងការធ្វើលិបិក្រមកាន់តែលឿន និងពេញលេញនៃគេហទំព័រ។

Sitemap: https://martech.zone/sitemap_index.xmlពាក្យបញ្ជាបន្ថែម robots.txt និងការប្រើប្រាស់របស់ពួកគេ។

- ភ្នាក់ងារអ្នកប្រើ: បញ្ជាក់ថាតើកម្មវិធីរុករកមួយណាដែលច្បាប់ត្រូវអនុវត្ត។ 'User-agent: *' អនុវត្តច្បាប់ទៅគ្រប់ crawlers ។ ឧទាហរណ៍៖

User-agent: Googlebot- Noindex៖ ទោះបីជាមិនមែនជាផ្នែកនៃពិធីការ robots.txt ស្តង់ដារ ម៉ាស៊ីនស្វែងរកមួយចំនួនយល់អំពី a ដែលមិនបានធ្វើលិបិក្រម ការណែនាំនៅក្នុង robots.txt ជាការណែនាំមិនឱ្យធ្វើលិបិក្រម URL ដែលបានបញ្ជាក់។

Noindex: /non-public-page/- ការពន្យាពេលវារ៖ ពាក្យបញ្ជានេះស្នើឱ្យអ្នកស្រាវជ្រាវឱ្យរង់ចាំរយៈពេលជាក់លាក់មួយរវាងការចូលទៅកាន់ម៉ាស៊ីនមេរបស់អ្នក ដែលមានប្រយោជន៍សម្រាប់គេហទំព័រដែលមានបញ្ហាផ្ទុកម៉ាស៊ីនមេ។

Crawl-delay: 10របៀបសាកល្បងឯកសារ Robots.txt របស់អ្នក។

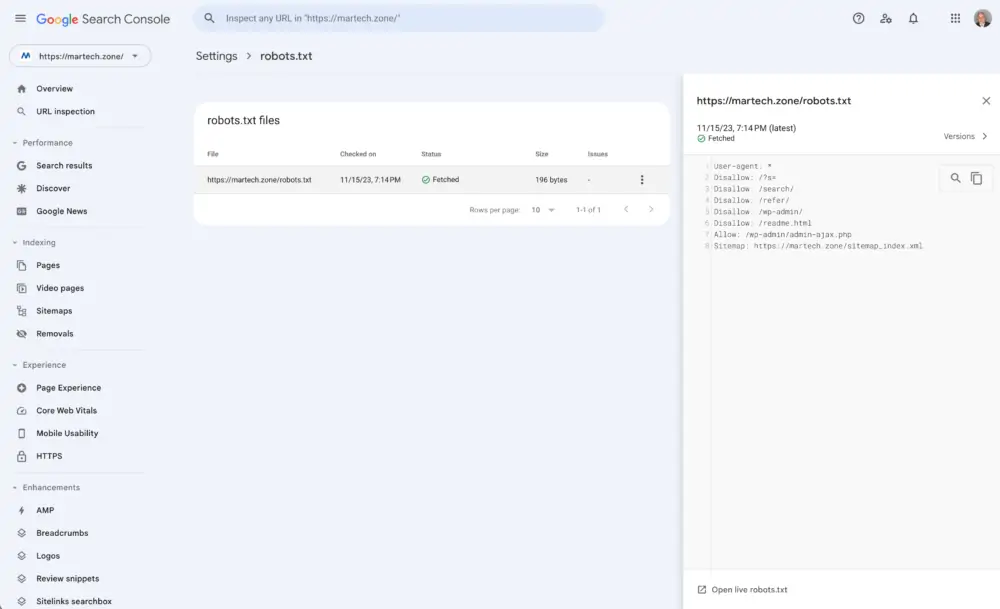

ទោះបីជាវាត្រូវបានកប់នៅក្នុង Google Search Consoleកុងសូលស្វែងរកផ្តល់ជូនអ្នកសាកល្បងឯកសារ robots.txt ។

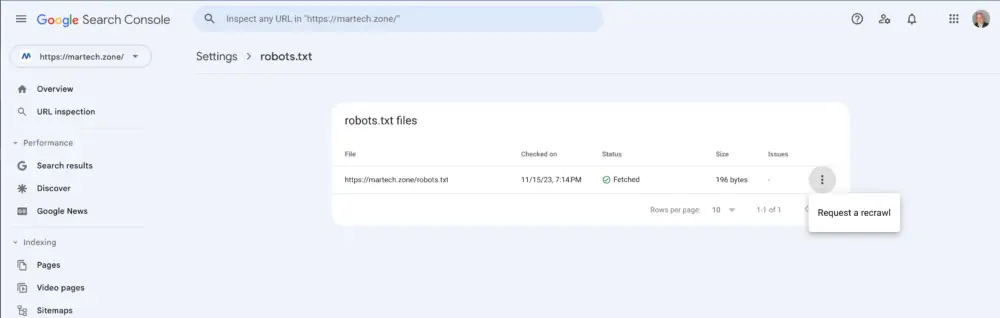

អ្នកក៏អាចដាក់បញ្ជូនឯកសារ Robots.txt របស់អ្នកឡើងវិញបានដោយចុចលើចំនុចទាំងបីនៅខាងស្តាំ ហើយជ្រើសរើស ស្នើសុំការប្រមូលឡើងវិញ.

សាកល្បង ឬបញ្ជូនឯកសារ Robots.txt របស់អ្នកឡើងវិញ

តើឯកសារ Robots.txt អាចប្រើដើម្បីគ្រប់គ្រង AI Bots បានទេ?

ឯកសារ robots.txt អាចត្រូវបានប្រើដើម្បីកំណត់ថាតើ AI bots រួមទាំង web crawlers និង bots ស្វ័យប្រវត្តិផ្សេងទៀត អាចរុករក ឬប្រើប្រាស់មាតិកានៅលើគេហទំព័ររបស់អ្នក។ ឯកសារណែនាំរូបយន្តទាំងនេះ ដោយបង្ហាញថាផ្នែកណាមួយនៃគេហទំព័រដែលពួកគេត្រូវបានអនុញ្ញាត ឬមិនអនុញ្ញាតពីការចូលប្រើ។ ប្រសិទ្ធភាពនៃ robots.txt គ្រប់គ្រងឥរិយាបថរបស់ AI bots អាស្រ័យលើកត្តាជាច្រើន៖

- ការប្រកាន់ខ្ជាប់នូវពិធីសារ៖ អ្នករុករកម៉ាស៊ីនស្វែងរកល្បីឈ្មោះបំផុត និងរូបយន្ត AI ជាច្រើនទៀតគោរពច្បាប់ដែលបានកំណត់

robots.txt. ទោះជាយ៉ាងណាក៏ដោយ វាជារឿងសំខាន់ក្នុងការកត់សម្គាល់ថា ឯកសារនោះមានសំណើច្រើនជាងការរឹតបន្តឹងដែលអាចអនុវត្តបាន។ Bots អាចមិនអើពើនឹងសំណើទាំងនេះ ជាពិសេសការដំណើរការដោយអង្គភាពដែលមិនសូវល្អ - ភាពជាក់លាក់នៃការណែនាំ៖ អ្នកអាចបញ្ជាក់ការណែនាំផ្សេងៗគ្នាសម្រាប់ bots ផ្សេងៗគ្នា។ ជាឧទាហរណ៍ អ្នកអាចអនុញ្ញាតឱ្យ AI bots ជាក់លាក់រុករកគេហទំព័ររបស់អ្នក ខណៈពេលដែលមិនអនុញ្ញាតអ្នកដទៃ។ នេះត្រូវបានធ្វើដោយប្រើ

User-agentការណែនាំនៅក្នុងrobots.txtឧទាហរណ៍ឯកសារខាងលើ។ ឧទាហរណ៍,User-agent: Googlebotនឹងបញ្ជាក់ការណែនាំសម្រាប់ crawler របស់ Google ចំណែកឯUser-agent: *នឹងអនុវត្តចំពោះ bots ទាំងអស់។ - ដែនកំណត់: ខណៈពេល

robots.txtអាចការពារ bots ពីការរុករកមាតិកាដែលបានបញ្ជាក់។ វាមិនលាក់មាតិកាពីពួកគេទេប្រសិនបើពួកគេដឹងរួចហើយ URL. លើសពីនេះ វាមិនផ្តល់មធ្យោបាយណាមួយដើម្បីដាក់កម្រិតលើការប្រើប្រាស់ខ្លឹមសារនោះទេ នៅពេលដែលវាត្រូវបានរុករក។ ប្រសិនបើការការពារខ្លឹមសារ ឬការរឹតបន្តឹងការប្រើប្រាស់ជាក់លាក់ត្រូវបានទាមទារ វិធីសាស្ត្រផ្សេងទៀតដូចជាការការពារពាក្យសម្ងាត់ ឬយន្តការគ្រប់គ្រងការចូលប្រើដ៏ទំនើបជាងនេះប្រហែលជាចាំបាច់។ - ប្រភេទនៃ Bots៖ មិនមែន AI bots ទាំងអស់ទាក់ទងនឹងម៉ាស៊ីនស្វែងរកទេ។ រូបយន្តផ្សេងៗត្រូវបានប្រើក្នុងគោលបំណងផ្សេងគ្នា (ឧទាហរណ៍ ការប្រមូលទិន្នន័យ ការវិភាគ ការលុបមាតិកា)។ ឯកសារ robots.txt ក៏អាចត្រូវបានប្រើដើម្បីគ្រប់គ្រងការចូលប្រើសម្រាប់ប្រភេទផ្សេងគ្នានៃ bots ដរាបណាពួកគេប្រកាន់ខ្ជាប់នូវ REP ។

នេះ robots.txt ឯកសារអាចជាឧបករណ៍ដ៏មានប្រសិទ្ធភាពសម្រាប់ផ្តល់សញ្ញាអំពីចំណូលចិត្តរបស់អ្នកទាក់ទងនឹងការរុករក និងការប្រើប្រាស់ខ្លឹមសារគេហទំព័រដោយ AI bots។ ទោះជាយ៉ាងណាក៏ដោយ សមត្ថភាពរបស់វាត្រូវបានកំណត់ចំពោះការផ្តល់នូវការណែនាំជាជាងការពង្រឹងការគ្រប់គ្រងការចូលប្រើប្រាស់យ៉ាងតឹងរ៉ឹង ហើយប្រសិទ្ធភាពរបស់វាអាស្រ័យទៅលើការអនុលោមតាម bots ជាមួយ Robots Exclusion Protocol។

ឯកសារ robots.txt គឺជាឧបករណ៍តូចមួយ ប៉ុន្តែខ្លាំងនៅក្នុងឃ្លាំង SEO ។ វាអាចមានឥទ្ធិពលយ៉ាងខ្លាំងទៅលើការមើលឃើញរបស់គេហទំព័រ និងដំណើរការម៉ាស៊ីនស្វែងរក នៅពេលប្រើត្រឹមត្រូវ។ តាមរយៈការគ្រប់គ្រងផ្នែកណាមួយនៃគេហទំព័រមួយដែលត្រូវបានរុករក និងធ្វើលិបិក្រម អ្នកគ្រប់គ្រងគេហទំព័រអាចធានាថាខ្លឹមសារដ៏មានតម្លៃបំផុតរបស់ពួកគេត្រូវបានបន្លិច ធ្វើអោយប្រសើរឡើងនូវកិច្ចខិតខំប្រឹងប្រែង SEO និងការអនុវត្តគេហទំព័ររបស់ពួកគេ។